Fases de proceso del big data

Los datos del big data se procesan en tres fases:

- Extracción: los datos son capturados de todas las fuentes y los centralizamos.

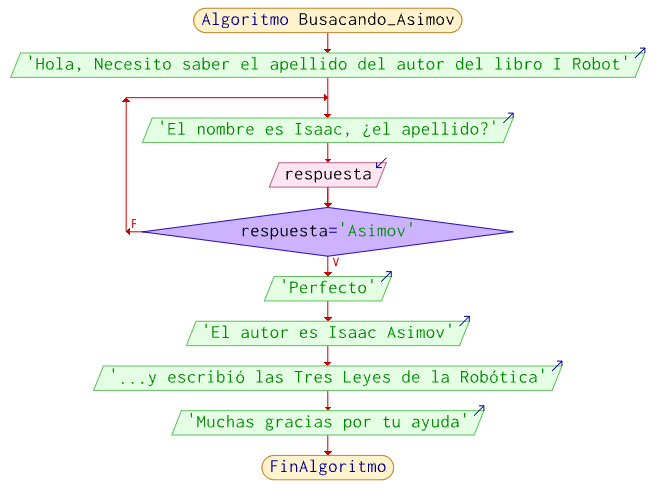

- Transformación: esta segunda fase consiste en estandarizar los datos que han sido capturados de diversas fuentes, hay que aplicarles un estándar (Data cleaning: que consiste en una técnica para limpiar los datos y homogenizarlos para que parezcan de la misma fuente. Esta fase requiere de un modelo o algoritmo, con ayuda del machine learning o aprendizaje automático.

- Almacenaje: la tercera fase consiste en guardar la información, hay que almacenarla en un Data Warehouse o centro de datos para su posterior análisis.

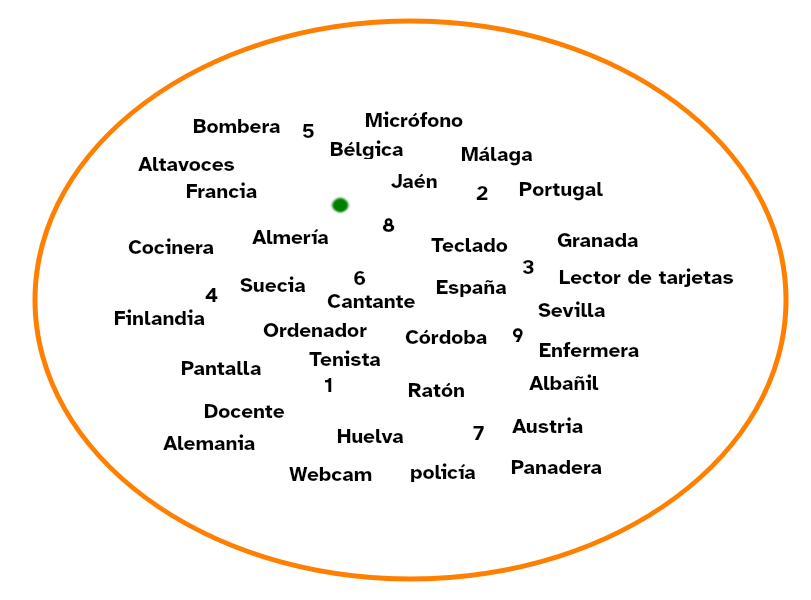

Scraping data

Una de las técnicas usadas en la primera fase de tratamiento de los datos del big data es el scraping data (arañar datos, raspar datos, en español), se refiere a la técnica en la que un programa informático extrae datos del resultado generado por otro programa para analizarlos o utilizarlos en otra parte. Normalmente estos programas simulan la navegación de una persona en internet.

El ejemplo más utilizado es el web scraping que utiliza una aplicación informática para leer y extraer datos valiosos de sitios web de forma automatizada, simulando la navegación web que haría una persona. En el caso de búsqueda de imágenes, el proceso se denomina Image Scraping.

El web scraping se utiliza para recopilar datos de contacto, tales como direcciones de correo electrónico o números de teléfono, o información especial como términos de búsqueda o URL, con gran rapidez. En el ámbito profesional, es scraping se utiliza para conseguir ventajas con respecto a la competencia.

El buscador de Google utiliza la tecnología de web scraping para mostrar información metereológica o comparaciones de precios de vuelos y hoteles.

Muchos portales de comparación de precios también utilizan el scraping para representar información de otros proveedores y sitios web.

¿Es legal el web scraping?

Cuidado porque el scraping no siempre es legal.

Los autores de un scraping de datos deben tener en cuenta los derechos de propiedad intelectual y la normativa de protección de datos de los sitios web.

Por otra parte, el web scraping puede tener consecuencias negativas para algunas empresas online y sitios web, por ejemplo, puede ralentizar la velocidad de conexión del sitio web.

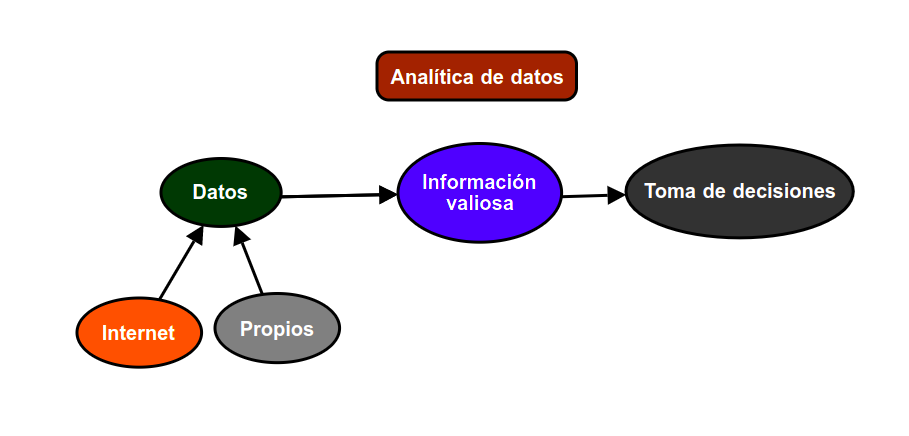

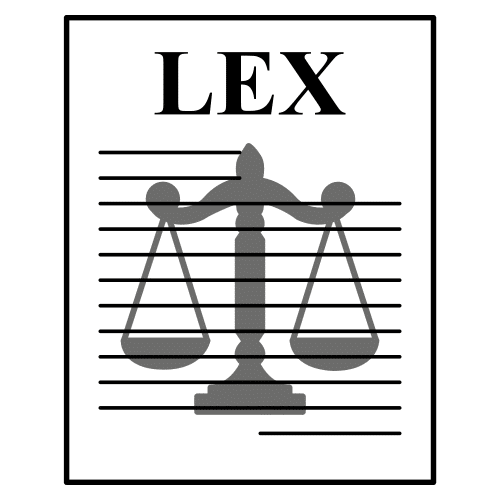

¿Qué es el data analytics o analítica de datos?

Se puede entender como un complemento web scraping.

Es un conjunto de tecnologías que analizan datos (extraídos de internet y propios de la organización) en busca de información valiosa en forma de patrones de comportamientos que ayuden en la toma de decisiones a una organización.

Por ejemplo a una organización le puede permitir conocer:

- A qué precio está vendiendo la competencia en internet.

- Cuál es la valoración de los clientes y compararlos con la competencia.

- Cuándo un producto baja un precio determinado.

- Extraer información de empresas de la competencia.

- Conocer quiénes son los clientes que más probabilidades de irse a la competencia.

- Factores que más influyen en el proceso productivo de la organización.

- ...

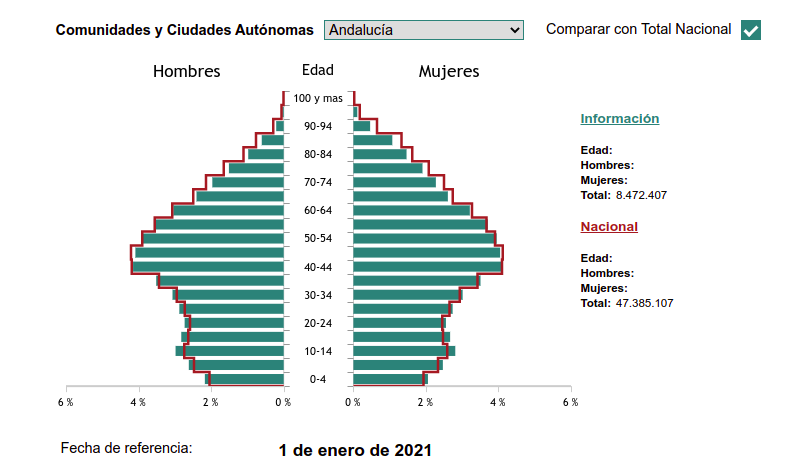

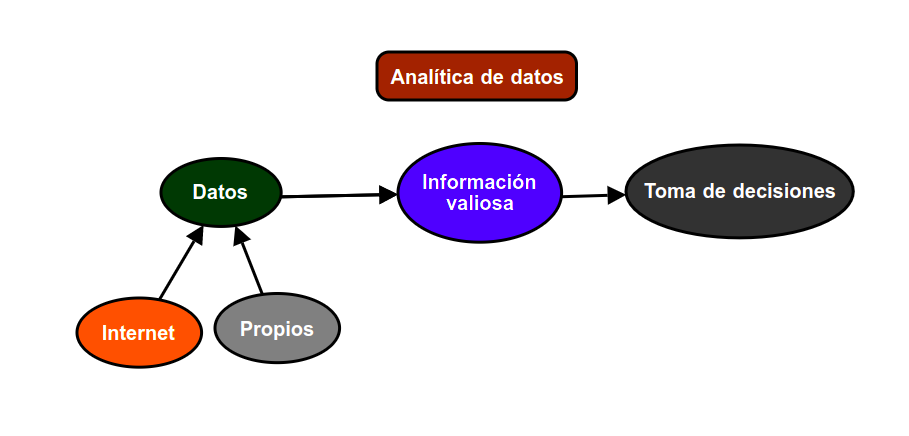

Visualización de datos del big data

Dentro del proceso de los grandes volúmenes de datos del big data suele ser de gran ayuda la representación gráfica de los mismos mediante el uso de gráficos, mapas, tablas, infografías, diagramas, etc., ya que facilita el análisis y comprensión de la información.

Existen una serie de herramientas informáticas que ayudan en esta tarea de visualización de datos del big data.

La representación gráfica de un conjunto de datos es fundamental para analizar su comportamiento, detectar tendencias, valores atípicos y patrones en los datos.

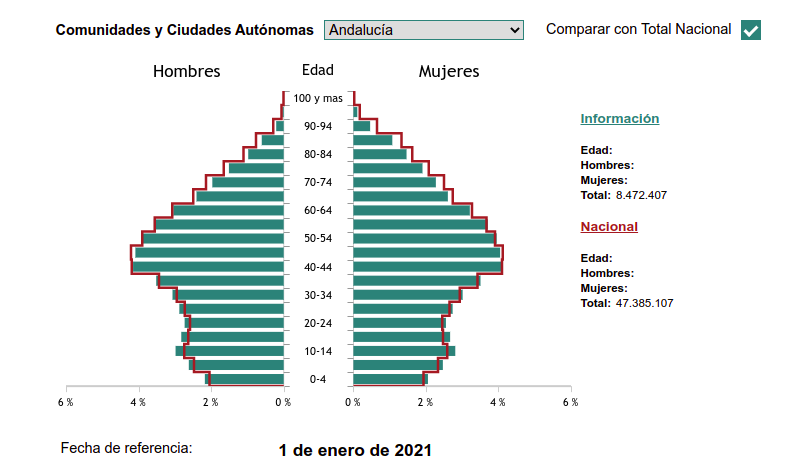

Un ejemplo de visualización de una gran cantidad de datos es la pirámide de la población empadronada en Andalucía y España a fecha 01 de enero de 2021